1. Introducción a los transformers

La inteligencia artificial (IA) ha experimentado avances significativos en los últimos años, y una de las tecnologías clave detrás de estos progresos son los transformers. Introducidos en el artículo influyente de 2017 titulado “Attention is All You Need“, los transformers han revolucionado el campo del procesamiento del lenguaje natural (NLP, por sus siglas en inglés).

Antes de la aparición de los transformers, modelos como las redes neuronales recurrentes (RNN) y las redes de memoria a largo plazo (LSTM) dominaban el panorama del NLP. Sin embargo, estos modelos presentaban ciertas limitaciones, como la dificultad para manejar dependencias a largo plazo en secuencias de texto. Los transformers, con su arquitectura innovadora basada en el mecanismo de atención (attention mechanism), superan estas limitaciones y permiten avances significativos en la comprensión y generación de lenguaje.

En este artículo, exploraremos en detalle qué son los transformers, sus componentes clave, cómo funcionan y cómo están transformando diversos campos, incluyendo la educación. Además, veremos cómo se comparan con otros modelos de lenguaje y qué depara el futuro para esta tecnología innovadora.

2. ¿Qué son los transformers?

Los transformers son una arquitectura de modelo de aprendizaje profundo que se ha convertido en un estándar en el campo del procesamiento del lenguaje natural (NLP). Originalmente introducidos por Vaswani et al. en el artículo “Attention is All You Need” en 2017, los transformers han revolucionado cómo las máquinas procesan y generan lenguaje.

Definición básica

Un transformer es un tipo de modelo de red neuronal que utiliza mecanismos de atención para ponderar la importancia de diferentes palabras en una secuencia. A diferencia de modelos anteriores como las RNN y LSTM, que procesan datos en secuencia, los transformers pueden procesar palabras en paralelo. Esto les permite manejar dependencias a largo plazo de manera más eficiente y mejorar el rendimiento en tareas de NLP.

Importancia en el campo de la inteligencia artificial

Los transformers han demostrado ser extremadamente eficientes en una variedad de aplicaciones de NLP. Algunas de las razones por las que son tan importantes incluyen:

- Velocidad de procesamiento: Gracias a su capacidad de procesamiento en paralelo, los transformers son significativamente más rápidos que las RNN y LSTM.

- Precisión mejorada: Los transformers pueden capturar dependencias a largo plazo y relaciones complejas entre palabras de manera más eficiente, lo que se traduce en una mayor precisión en tareas de traducción, generación de texto y análisis de sentimientos.

- Versatilidad: Los transformers se utilizan en una amplia gama de aplicaciones, desde traductores automáticos hasta sistemas de recomendación y asistentes virtuales.

En resumen, los transformers son una arquitectura poderosa y flexible que ha cambiado el paradigma del NLP. Su capacidad para procesar datos en paralelo y manejar dependencias a largo plazo los hace superiores a modelos anteriores, allanando el camino para nuevas innovaciones en la IA.

3. Componentes clave de un transformer

Para entender cómo funcionan los transformers, es esencial conocer sus componentes clave. Estos elementos permiten a los transformers procesar y generar texto de manera efectiva y eficiente. A continuación se detallan los componentes principales:

Embedding

El embedding es el primer paso en el procesamiento de texto por los transformers. Aquí, cada palabra o token de entrada se convierte en un vector de alta dimensionalidad. Estos vectores representan no solo la palabra en sí, sino también su contexto y relación con otras palabras. Los embeddings permiten que el modelo capture significados semánticos complejos.

Atenciones

Uno de los componentes más innovadores de los transformers es el mecanismo de atención (attention mechanism). Existen dos tipos principales de atenciones:

- Atención propia (Self-Attention): Este mecanismo permite al modelo evaluar la importancia de cada palabra en una secuencia con respecto a otras palabras de la misma secuencia. Es crucial para capturar dependencias a largo plazo.

- Atención cruzada (Cross-Attention): Este tipo de atención es utilizado principalmente en modelos de traducción, permitiendo al sistema alinear palabras de una secuencia de entrada con palabras de una secuencia de salida.

Feedforward Neural Network (Red Neuronal Feedforward)

Después del mecanismo de atención, cada token pasa por una Red Neuronal Feedforward (FFNN). Esta red consiste en una serie de capas densas que procesan los embeddings enriquecidos por la atención para producir una nueva representación. Este paso ayuda a refinar las características extraídas por el mecanismo de atención.

Mecanismo de normalización y residuals

Para estabilizar y acelerar el entrenamiento, los transformers utilizan mecanismos de normalización (como la normalización por lotes o batch normalization) y conexiones residuales. Las conexiones residuales permiten que la información fluya más fácilmente a través de las capas del modelo, evitando problemas de degradación del gradiente.

Cabezas múltiples (Multi-Head Attention)

El componente de Multi-Head Attention introduce múltiples mecanismos de atención paralelos en el mismo bloque. Esto permite al modelo aprender diferentes aspectos de la relación entre palabras en paralelo, mejorando la capacidad del modelo para capturar relaciones complejas y matices sutiles en el texto.

En conjunto, estos componentes hacen que los transformers sean una herramienta poderosa para el procesamiento avanzado del lenguaje. La combinación de embeddings, atención, redes feedforward, normalización y mecanismos de múltiples cabezas permite a los transformers superar las limitaciones de modelos anteriores y establecen un nuevo estándar en la IA.

4. Funcionamiento de los transformers

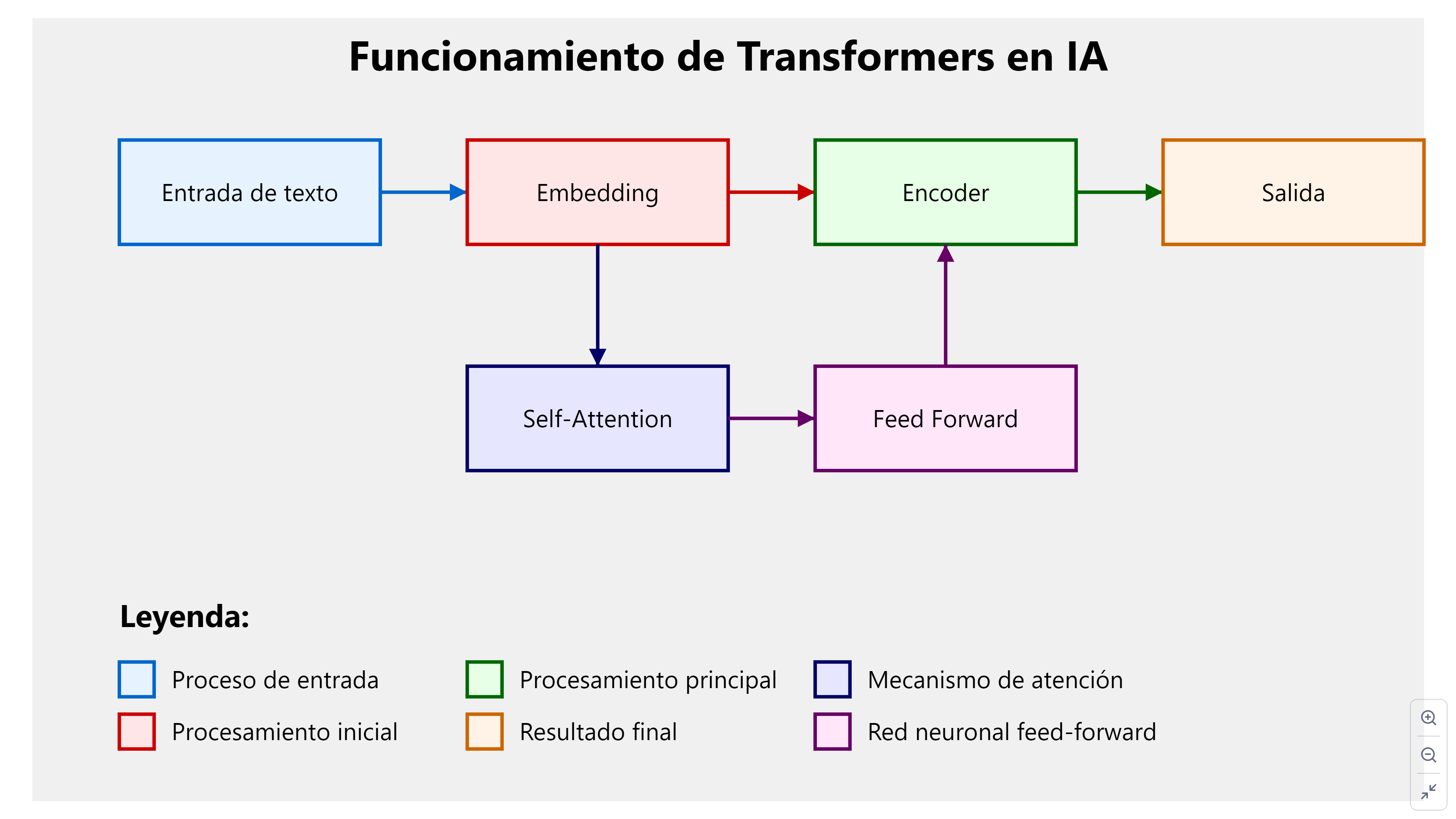

Ahora que hemos explorado los componentes clave, es hora de entender el funcionamiento de los transformers en acción. Este capítulo cubrirá el proceso completo desde la entrada de datos hasta la generación de resultados.

Tokenización

El primer paso en el procesamiento de texto con transformers es la tokenización. Este proceso convierte una secuencia de texto en una serie de tokens (palabras o subpalabras). Los tokens son luego transformados en embeddings que el modelo puede procesar.

Proceso de entrenamiento

El entrenamiento de un modelo transformer involucra grandes cantidades de datos y computación intensiva. Durante el entrenamiento, el modelo aprende a predecir la siguiente palabra en una secuencia de texto dado el contexto proporcionado por las palabras anteriores. Esta tarea se conoce como modelado de lenguaje. El modelo ajusta sus pesos internos para minimizar la diferencia entre sus predicciones y las palabras reales en el conjunto de datos de entrenamiento.

Lenguaje natural y predicción de palabras

Una vez que el modelo ha sido entrenado, puede ser utilizado para diversas tareas de NLP. Por ejemplo, en la traducción automática, el modelo puede tomar una secuencia de texto en un idioma y generar la traducción correspondiente en otro idioma. En la generación automática de textos, el modelo puede producir texto coherente basado en un inicio proporcionado por el usuario.

Ejemplo ilustrativo de procesamiento

Supongamos que tenemos la frase “El clima está muy soleado hoy”. Aquí hay un ejemplo ilustrativo de cómo un transformer procesaría esta frase:

- Tokenización: La frase se divide en tokens: [“El”, “clima”, “está”, “muy”, “soleado”, “hoy”].

- Embedding: Cada token se convierte en un vector de alta dimensionalidad.

- Atención propia: El modelo evalúa la importancia de cada palabra en relación con las demás en la secuencia. Por ejemplo, “soleado” puede tener una alta relación con “clima”.

- Red Feedforward: Los vectores resultantes se pasan a través de capas de redes neuronales densas para ajustar sus representaciones.

- Generación de resultados: El modelo puede utilizar esta información para realizar tareas como completar la frase o responder a preguntas sobre el clima.

El proceso puede parecer complejo, pero la ventaja de los transformers es su capacidad para manejar múltiples relaciones y dependencias en paralelo, lo que resulta en un rendimiento superior en tareas de NLP.

Estos pasos son fundamentales para comprender cómo los transformers están capacitados para realizar tareas complejas de procesamiento del lenguaje natural. Gracias a su arquitectura innovadora, los transformers han superado a los modelos anteriores y han abierto nuevas posibilidades en la IA.

5. Comparación con otros modelos de lenguaje

Para entender la verdadera innovación que representan los transformers, es útil compararlos con otros modelos de lenguaje que han sido prominentes en el campo de la inteligencia artificial.

RNN (Redes Neuronales Recurrentes)

Las redes neuronales recurrentes (RNN) fueron uno de los primeros modelos utilizados para el procesamiento del lenguaje natural (NLP). Las RNN procesan secuencias de datos una palabra a la vez, manteniendo una memoria de las palabras anteriores a través de estados recurrentes. Sin embargo, las RNN tienen limitaciones significativas, como la dificultad para capturar dependencias a largo plazo debido a problemas de gradientes que se desvanecen o explotan.

LSTM (Long Short-Term Memory)

Para superar las limitaciones de las RNN, se desarrollaron las redes de memoria a largo plazo (LSTM). Estas redes mejoran las RNN al incorporar una célula de memoria que puede retener información por períodos más largos. A pesar de ser más efectivas que las RNN para capturar dependencias a largo plazo, las LSTM aún tienen limitaciones en cuanto a la paralelización y la eficiencia del procesamiento de secuencias largas.

Ventajas de los transformers sobre modelos previos

Los transformers superan a las RNN y LSTM en varios aspectos clave:

- Procesamiento en paralelo: A diferencia de las RNN y LSTM, que procesan secuencias de palabras una a la vez, los transformers pueden procesar todas las palabras de una secuencia en paralelo. Esto resulta en una mayor eficiencia y velocidad de procesamiento.

- Manejo de dependencias a largo plazo: Gracias a su mecanismo de atención, los transformers pueden capturar relaciones a largo plazo entre palabras de manera más efectiva. Esto les permite generar texto y realizar traducciones con una precisión superior.

- Escalabilidad: Los transformers son más escalables y fáciles de entrenar en conjuntos de datos grandes, lo que los hace ideales para aplicaciones que requieren altos volúmenes de datos.

En resumen, mientras que las RNN y LSTM han sido fundamentales en el desarrollo del NLP, los transformers representan un avance significativo al abordar sus limitaciones y ofreciendo mejoras en velocidad, precisión y escalabilidad.

6. Aplicaciones de los transformers

Los transformers no solo han demostrado ser teóricamente innovadores, sino que también se han traducido en aplicaciones prácticas que están cambiando diversas industrias. A continuación se describen algunas de las aplicaciones más destacadas de los transformers:

Procesamiento del lenguaje natural

El procesamiento del lenguaje natural (NLP) es el área donde los transformers han tenido quizás el mayor impacto. Los modelos basados en transformers, como BERT (Bidirectional Encoder Representations from Transformers) y GPT (Generative Pre-trained Transformer), han mejorado drásticamente tareas de NLP como la comprensión de texto, clasificación de sentimientos y generación de texto.

Traducción automática

Los transformers han revolucionado la traducción automática. Modelos como Google Translate ahora usan transformers para traducir entre múltiples idiomas con una precisión asombrosa. La capacidad de los transformers para comprender el contexto y las dependencias a largo plazo mejora significativamente la calidad de las traducciones.

Resúmenes automáticos

Otra aplicación importante es la generación de resúmenes automáticos. Los transformers pueden leer documentos largos y generar resúmenes concisos y coherentes. Esto es especialmente útil en campos como la investigación y la gestión de información, donde es crucial procesar grandes volúmenes de texto rápidamente.

Chatbots y asistentes virtuales

Los chatbots y asistentes virtuales como Google Assistant, Amazon Alexa y Siri también se benefician de los transformers. Estos modelos mejoran la interacción y pasan a ser más naturales y contextualmente relevantes. La capacidad de los transformers para entender y generar lenguaje natural en tiempo real mejora la experiencia del usuario.

Generación de texto

Los transformers también son utilizados para la generación de texto, como la escritura automática de artículos, guiones y hasta historias completas. Modelos avanzados como GPT-3 pueden generar texto que es casi indistinguible del escrito por humanos, abriendo nuevas posibilidades en la creación de contenidos.

En resumen, las aplicaciones de los transformers son vastas y variadas, tocando múltiples sectores y mejorando la forma en que interactuamos con la tecnología. Desde la traducción automática hasta la generación de contenido y los asistentes virtuales, los transformers están redefiniendo lo posible en la inteligencia artificial.

7. Impacto de los transformers en la educación

Los transformers están teniendo un impacto significativo en el ámbito de la educación, proporcionando herramientas avanzadas que mejoran tanto la enseñanza como el aprendizaje. A continuación se detallan algunos de los efectos más relevantes:

Prácticas pedagógicas

Los transformers están revolucionando las prácticas pedagógicas al proporcionar herramientas que ayudan a los profesores a crear materiales educativos más atractivos y personalizados. Los modelos de NLP basados en transformers pueden analizar grandes cantidades de datos educativos y generar resúmenes, esquemas y materiales de lectura adaptados a las necesidades de los estudiantes.

Personalización del aprendizaje

Una de las aplicaciones más poderosas de los transformers es en la personalización del aprendizaje. Los sistemas educativos impulsados por IA pueden utilizar transformers para analizar el progreso y las necesidades individuales de cada estudiante, recomendando recursos y actividades personalizadas. Esto no solo mejora la eficacia del aprendizaje, sino que también hace que la educación sea más inclusiva y accesible.

Asistentes educativos inteligentes

Los asistentes educativos inteligentes, como los chatbots basados en transformers, están facilitando el aprendizaje autónomo y el acceso a la información. Estos asistentes pueden responder preguntas de los estudiantes, proporcionar explicaciones detalladas y guiar el proceso de aprendizaje de una manera interactiva y dinámica. Además, pueden estar disponibles las 24 horas del día, los 7 días de la semana, ofreciendo soporte continuo.

En resumen, los transformers están transformando la educación al ofrecer nuevas herramientas y enfoques que mejoran la enseñanza y el aprendizaje. Su capacidad para personalizar el contenido y proporcionar asistencia continua está creando un entorno educativo más dinámico y efectivo.

8. Futuro de los transformers en IA

El futuro de los transformers en la inteligencia artificial promete ser emocionante e innovador. A medida que la investigación y el desarrollo de esta tecnología continúan avanzando, podemos anticipar una serie de tendencias y desafíos emergentes.

Innovaciones emergentes

Una de las principales áreas de innovación es la mejora continua de los modelos de transformers. La aparición de modelos de próxima generación como GPT-4 y BERT de mayor tamaño y precisión está llevando las capacidades de procesamiento del lenguaje natural a niveles sin precedentes. Estos modelos están siendo entrenados con conjuntos de datos aún más grandes y variados, lo que los hace más robustos y versátiles.

Otra tendencia notable es la integración de transformers con otras áreas de la inteligencia artificial, como el aprendizaje profundo multimodal. Esto permitirá a los transformers procesar y generar datos que combinan texto, imágenes, audio y video, abriendo nuevas posibilidades en aplicaciones como la realidad aumentada y la creación de contenido multimedia.

Desafíos y consideraciones éticas

A pesar de los avances, también existen desafíos y consideraciones éticas que deben ser abordados. Uno de los principales problemas es la necesidad de transparencia y explicabilidad en los modelos de transformers. A medida que estos modelos se vuelven más complejos, se hace más difícil entender cómo llegan a sus decisiones y predicciones.

Además, es crucial considerar los sesgos inherentes en los conjuntos de datos utilizados para entrenar los transformers. Si no se aborda adecuadamente, estos sesgos pueden perpetuar inequidades y conducir a resultados injustos o discriminatorios.

El futuro de los transformers en la IA es prometedor, pero también requerirá una consideración cuidadosa de los desafíos éticos y técnicos. Con una investigación y desarrollo responsables, los transformers tienen el potencial de seguir transformando una amplia gama de aplicaciones y sectores.

Redes neuronales recurrentes: procesamiento de datos secuenciales

Redes neuronales convolucionales: reconocimiento de imágenes